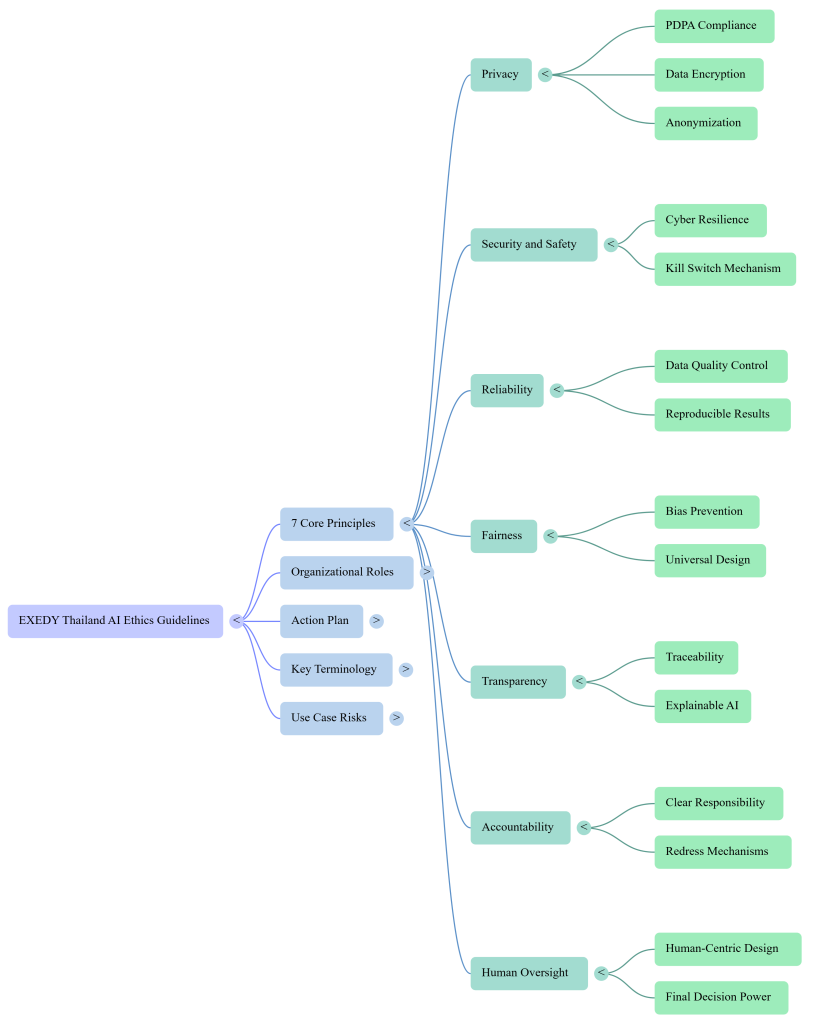

แนวปฏิบัติจริยธรรมปัญญาประดิษฐ์สำหรับ EXEDY Thailand

การออกแบบโดยอ้างอิงจากหลักการสากลและแนวทางของประเทศไทย (NSTDA และ Thailand AI Ethics Guideline) เพื่อเป็นกรอบการดำเนินงานที่ครอบคลุมทุกมิติ ตั้งแต่การวิจัย การพัฒนา ไปจนถึงการใช้งานจริงในองค์กร

-

- ความเป็นส่วนตัว (Privacy): ต้องประเมินและปกป้องข้อมูลที่ใช้ในระบบ AI โดยเฉพาะข้อมูลพนักงานและลูกค้าให้ปฏิบัติตาม พ.ร.บ. คุ้มครองข้อมูลส่วนบุคคล (PDPA) อย่างเคร่งครัด รวมถึงใช้กระบวนการรักษาความปลอดภัย เช่น การเข้ารหัสข้อมูล (Encryption) หรือการทำให้ข้อมูลไม่สามารถระบุตัวตนได้ (Anonymization)

- ความมั่นคงและความปลอดภัย (Security and Safety): ระบบ AI ต้องมีความทนทานต่อการโจมตีทางไซเบอร์ (Resilience) และต้องมีขั้นตอนการหยุดการทำงานของระบบอย่างปลอดภัย (Kill Switch) ในกรณีที่เกิดเหตุการณ์ไม่คาดคิดหรือระบบทำงานผิดปกติเพื่อป้องกันอันตราย

- ความไว้วางใจ (Reliability): ต้องมีการควบคุมคุณภาพของข้อมูล (Data Quality) ก่อนนำเข้าสู่ระบบ เพื่อให้ผลลัพธ์จาก AI มีความแม่นยำ สามารถสร้างผลลัพธ์แบบเดิมซ้ำได้ (Reproducible) เพื่อสร้างความเชื่อมั่นและป้องกันผลลัพธ์ที่ผิดพลาด

- ความเป็นธรรม ความเท่าเทียม และไม่แบ่งแยก (Fairness and Non-discrimination): AI ที่ใช้ในองค์กรจะต้องไม่มีอคติ (Bias) หรือสร้างความไม่เท่าเทียม โดยเฉพาะในกระบวนการที่ส่งผลต่อพนักงาน เช่น ระบบการคัดเลือกหรือประเมินผล และควรพิจารณาถึงการรองรับผู้ใช้งานทุกกลุ่ม (Universal Design)

- ความโปร่งใสและอธิบายได้ (Transparency and Explainability): กระบวนการตัดสินใจของ AI ต้องสามารถสืบย้อนแหล่งที่มาและข้อมูลได้ (Traceability) และต้องสามารถระบุวัตถุประสงค์รวมถึงอธิบายเหตุผลของผลลัพธ์ให้ผู้เกี่ยวข้องทราบอย่างชัดเจนด้วยภาษาที่มนุษย์เข้าใจง่าย

- ภาระความรับผิด (Accountability): ต้องมีการกำหนดบทบาทหน้าที่และผู้รับผิดชอบในทุกขั้นตอนของวงจรชีวิต AI ในองค์กรให้ชัดเจน รวมถึงต้องมีกลไกรับเรื่องร้องเรียนและแก้ไขเยียวยาหากระบบ AI ก่อให้เกิดความเสียหาย

- มนุษย์เป็นผู้ควบคุมปัญญาประดิษฐ์ (Human Oversight and Agency): AI ต้องเป็นเทคโนโลยีที่ส่งเสริมคุณค่าของมนุษย์ (Human-Centric) โดยพนักงานจะต้องมีอำนาจในการแทรกแซงหรือเป็นผู้ตัดสินใจในขั้นสุดท้ายเสมอ

Link: จริยธรรม AI Mind Map

2. บทบาทและหน้าที่รับผิดชอบในองค์กร (Internal Accountability)

เพื่อให้การดำเนินงานเป็นรูปธรรม EXEDY Thailand ควรกำหนดโครงสร้างความรับผิดชอบ ดังนี้:

| บทบาท | หน้าที่รับผิดชอบ |

| คณะกรรมการจริยธรรม AI |

ให้คำปรึกษา บริหารจัดการความเสี่ยง และพิจารณาเรื่องร้องเรียน |

| ผู้บริหารระดับสูง |

กำกับดูแลนโยบายภาพรวมให้สอดคล้องกับจริยธรรมและกฎหมาย |

| หัวหน้าโครงการ/ผู้พัฒนา |

ประเมินความเสี่ยงรายโครงการ และติดตามผลกระทบหลังใช้งานจริง |

| พนักงานผู้ใช้งาน (Users) |

ศึกษาคู่มือการใช้งาน แจ้งปัญหาที่พบ และให้ผลสะท้อนกลับ (Feedback) |

3. แนวทางการดำเนินงานเชิงปฏิบัติ (Actionable Implementation Plan)

ระยะที่ 1: การประเมินและการเตรียมความพร้อม

-

การศึกษาและอบรม: จัดอบรมหลักสูตร AI Ethics ให้กับทีมไอทีและฝ่ายที่เกี่ยวข้อง เพื่อสร้างความตระหนักรู้ถึงผลกระทบและแนวทางจริยธรรม

-

การประเมินความเสี่ยง: วิเคราะห์ระบบ AI ในองค์กรตามระดับความเสี่ยง (เช่น ระบบคัดกรองอีเมลขยะเป็นความเสี่ยงต่ำ ส่วนระบบตัดสินใจด้านบุคคลเป็นความเสี่ยงสูง)

ระยะที่ 2: การจัดการข้อมูลและการพัฒนา (Development)

-

ธรรมาภิบาลข้อมูล (Data Governance): จัดทำ “Datasheet” สำหรับชุดข้อมูลที่ใช้ โดยระบุวัตถุประสงค์ แหล่งที่มา และข้อจำกัดของข้อมูล

-

การทดสอบในวงแคบ: ก่อนใช้งานจริง ต้องมีการทดสอบในสภาพแวดล้อมควบคุมเพื่อหาอคติ (Bias Test) และความผิดปกติ

ระยะที่ 3: การใช้งานและการตรวจสอบ (Deployment & Monitoring)

-

ระบบตรวจสอบ: มีการเฝ้าระวังและวินิจฉัยความผิดพลาดของระบบ AI อย่างสม่ำเสมอ

-

การเยียวยา: จัดตั้งช่องทางรับเรื่องร้องเรียนและมีกระบวนการเยียวยาหากระบบ AI ส่งผลกระทบเชิงลบต่อพนักงานหรือลูกค้า

4. กรณีศึกษาที่ควรระวัง (Use Case Examples)

-

การรู้จำใบหน้า (Face Recognition): หากนำมาใช้ลงเวลาเข้างาน ต้องได้รับความยินยอมโดยสมัครใจ และไม่นำข้อมูลไปใช้เพื่อวัตถุประสงค์อื่นนอกเหนือจากที่แจ้งไว้

-

การใช้ดีปเฟก (Deepfake): ป้องกันพนักงานจากการถูกแอบอ้างโดยใช้ AI สร้างสื่อปลอม และให้ความรู้แก่คนในองค์กรถึงความเสี่ยงของเทคโนโลยีนี้

การนำแนวปฏิบัตินี้ไปใช้จะช่วยให้ EXEDY Thailand ก้าวไปสู่การเป็นองค์กรอัจฉริยะที่ใช้เทคโนโลยี AI อย่างมีจริยธรรม มั่นคง และได้รับความไว้วางใจจากผู้มีส่วนได้ส่วนเสียทุกกลุ่ม